Artificial Intelligence

Maschinelles Lernen: LLMs, GPT-4 & Anwendungen im Kundenservice

Was ist Maschinelles Lernen? Von klassischen Algorithmen bis zu LLMs und GPT-4: Methoden, Praxisbeispiele und Anwendungen im Kundenservice – aktualisiert für 2026.

Maschinelles Lernen (ML) hat sich von einem Nischenthema in der Forschung zur Kerntechnologie hinter den wichtigsten digitalen Produkten der Welt entwickelt. Mit dem Aufstieg von Large Language Models (LLMs) wie GPT-4 und Generativer KI erlebt das Feld seit 2022 eine nie dagewesene Beschleunigung – mit direkten Auswirkungen auf den Kundenservice, die Softwareentwicklung und nahezu jede Branche.

Dieser Artikel erklärt, wie Maschinelles Lernen funktioniert, welche Methoden es gibt, wie sich ML zu modernen LLMs wie GPT-4 weiterentwickelt hat und wie Unternehmen es heute konkret im Kundenservice einsetzen.

- Was ist Maschinelles Lernen?

- Die drei Lernarten: überwacht, unüberwacht, bestärkend

- Techniken und Methoden des maschinellen Lernens

- Machine Learning vs. Deep Learning

- LLMs und GPT-4: Die neue Ära des Maschinellen Lernens

- Praxisbeispiele: Maschinelles Lernen in Aktion

- ML im Kundenservice: Wie OMQ es einsetzt

- Herausforderungen und ethische Fragen

- Die Zukunft des Maschinellen Lernens

- FAQ

Was ist Maschinelles Lernen?

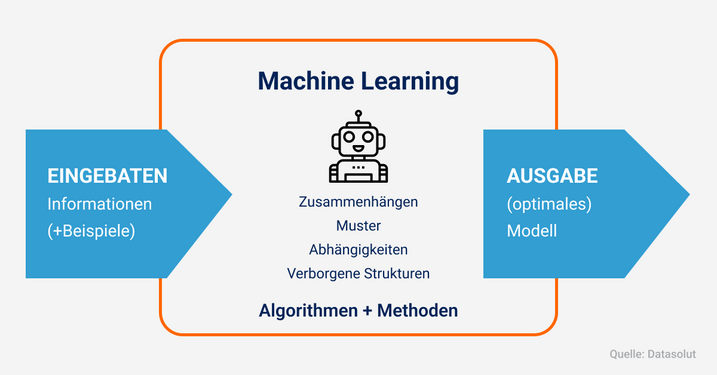

Maschinelles Lernen ist ein zentraler Teilbereich der Künstlichen Intelligenz (KI). Es ermöglicht Computern, aus Daten zu lernen, Muster zu erkennen und automatisierte Vorhersagen zu treffen – ganz ohne explizite Programmierung jedes einzelnen Schritts.

Im Gegensatz zur klassischen Programmierung, bei der Entwickler:innen exakte Regeln und Anweisungen kodieren, lernen ML-Modelle selbständig aus Beispieldaten. Je mehr qualitativ hochwertige Daten ein Modell erhält, desto besser werden seine Vorhersagen.

Definition:

Maschinelles Lernen ist die Fähigkeit eines Computersystems, aus Erfahrung zu lernen und seine Leistung zu verbessern, ohne explizit für jede Aufgabe programmiert zu werden (nach Arthur Samuel, 1959).

Die drei Lernarten

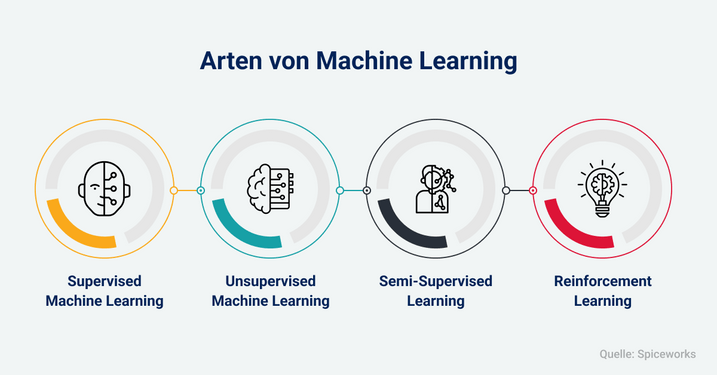

Es gibt drei fundamentale Kategorien des Maschinellen Lernens:

1. Überwachtes Lernen (Supervised Learning)

Beim überwachten Lernen wird das Modell mit beschrifteten Trainingsdaten gefüttert – also Daten, bei denen die richtige Antwort bereits bekannt ist. Das Modell lernt, Eingaben auf Ausgaben abzubilden. Typische Anwendungen: Spam-Filter, Bildklassifikation, Kreditrisikobewertung, automatische Textkategorisierung.

2. Unüberwachtes Lernen (Unsupervised Learning)

Hier arbeitet der Algorithmus mit unbeschrifteten Daten und sucht eigenständig nach Mustern und Strukturen. Es gibt keine vordefinierten „richtigen” Antworten. Typische Anwendungen: Kundensegmentierung, Anomalieerkennung, Empfehlungssysteme.

3. Bestärkendes Lernen (Reinforcement Learning)

Ein Agent lernt durch Versuch und Irrtum: Er erhält Belohnungen für gute Entscheidungen und Bestrafungen für schlechte. Über viele Iterationen entwickelt er eine optimale Strategie. Bekannte Anwendungen: Schach- und Go-Systeme (AlphaGo), Robotersteuerung, Optimierung von Lieferketten.

Unterarten des maschinellen Lernens.

Techniken und Methoden

Preprocessing (Datenvorverarbeitung)

Bevor Daten analysiert werden können, müssen sie aufbereitet werden: Entfernen von Rauschen und Ausreißern, Umgang mit fehlenden Werten, Normalisierung, Kodierung von Kategorien. Die Qualität der Eingabedaten bestimmt maßgeblich die Qualität des Modells – „Garbage in, garbage out.”

Algorithmen

Die Wahl des Algorithmus hängt von Aufgabe und Datenlage ab:

| Algorithmus | Einsatzgebiet |

|---|---|

| Lineare Regression | Zahlenwertvorhersage (z. B. Preise) |

| Entscheidungsbäume | Klassifikation strukturierter Daten |

| Random Forests | Robuste Klassifikation, Feature-Selektion |

| Support Vector Machines | Binärklassifikation, Textklassifikation |

| Neuronale Netze | Bild-, Sprach-, Textverarbeitung |

| Transformer / LLMs | Sprachverständnis, Texterzeugung, Chat |

Validierung

Nach dem Training wird das Modell auf separaten Testdaten evaluiert, um Overfitting (Überanpassung an Trainingsdaten) zu erkennen. Typische Metriken: Accuracy, Precision, Recall, F1-Score, AUC-ROC.

Optimierung

Hyperparameter-Tuning, Regularisierung (L1/L2), Dropout, Ensemble-Methoden und – bei neuronalen Netzen – das Training mit Gradienten-Abstieg sorgen dafür, dass Modelle generalisieren statt auswendig zu lernen.

Maschinelles Lernen einfach erklärt.

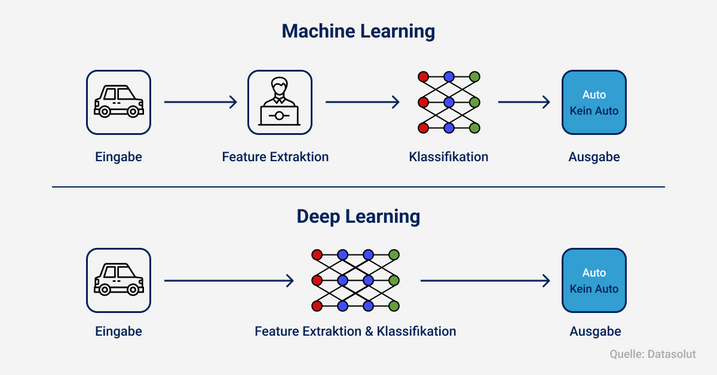

Machine Learning vs. Deep Learning

Der Unterschied zwischen Machine Learning (ML) und Deep Learning (DL) liegt in der Komplexität der Architektur und der Art der verarbeitbaren Daten.

Machine Learning nutzt klassische Algorithmen (Entscheidungsbäume, SVMs, lineare Modelle) und eignet sich besonders gut für strukturierte, tabellarische Daten. Es ist interpretierbar, benötigt weniger Rechenleistung und kommt oft mit weniger Trainingsdaten aus.

Deep Learning ist eine Unterklasse des ML und verwendet künstliche neuronale Netze mit vielen Schichten (daher „deep”). Es kann abstrakte Muster in unstrukturierten Daten wie Bilder, Audio und Text erkennen – und ist die Grundlage für moderne Natural Language Processing (NLP)-Systeme.

Faustregel:

ML eignet sich für strukturierte Daten und klare Vorhersageaufgaben. Deep Learning ist die erste Wahl für Spracherkennung, Bildverarbeitung, NLP und – seit 2022 – für die Entwicklung großer Sprachmodelle.

Der Unterschied in der Funktionsweise von ML und DL.

LLMs und GPT-4: Die neue Ära des Maschinellen Lernens

Seit dem Durchbruch von ChatGPT Ende 2022 und dem Release von GPT-4 im März 2023 hat sich das Feld des Maschinellen Lernens grundlegend gewandelt. Large Language Models (LLMs) sind besonders große neuronale Netze, die auf Basis der Transformer-Architektur mit gewaltigen Textmengen trainiert werden – und dabei ein umfassendes Sprachverständnis entwickeln.

Was macht LLMs besonders?

Klassische ML-Modelle werden für eine spezifische Aufgabe trainiert (z. B. Spam-Erkennung). LLMs hingegen sind Foundation Models: Sie werden einmal auf riesigen Datenmengen vortrainiert und können anschließend durch sogenanntes Fine-Tuning oder Prompt-Engineering auf viele verschiedene Aufgaben angepasst werden.

- GPT-4 (OpenAI): Multimodales Modell, das Text und Bilder versteht; Grundlage für viele KI-gestützte Anwendungen

- Claude (Anthropic): Besonders sicher und kontextstark; wird für komplexe Analysen eingesetzt

- Gemini (Google DeepMind): Integration in Google-Produkte, stark bei faktischem Wissen

- Llama (Meta): Open-Source-Modell, das Unternehmen selbst hosten können

Retrieval-Augmented Generation (RAG)

Ein wichtiges Konzept im LLM-Einsatz für Unternehmen ist RAG: Das Modell greift beim Antworten aktiv auf eine unternehmenseigene Wissensdatenbank zu, statt ausschließlich auf sein Training. Dadurch sind die Antworten aktuell, quellenbasiert und auf den Unternehmenskontext zugeschnitten – besonders relevant für den Einsatz im Kundenservice.

Mehr dazu im Lexikonartikel: Was ist ein Large Language Model? und Was ist ein Sprachmodell?

Praxisbeispiele: Maschinelles Lernen in Aktion

Maschinelles Lernen ist heute in fast allen Branchen präsent:

Medizin

ML-Modelle analysieren medizinische Bilder (Röntgen, MRT) mit einer Präzision, die oft der von Fachärzt:innen entspricht. Zudem helfen Algorithmen dabei, Behandlungspläne zu personalisieren oder Krankheiten früh zu erkennen – z. B. Diabetische Retinopathie oder frühe Tumorstadien.

Finanzwelt

Banken nutzen ML für Echtzeit-Betrugserkennung: Jede Transaktion wird in Millisekunden gegen Verhaltensmuster abgeglichen. Kreditscoring-Modelle ersetzen statische Regeln durch dynamische Lernprozesse, die tausende von Datenpunkten berücksichtigen.

E-Commerce & Personalisierung

Empfehlungssysteme wie bei Amazon oder Netflix basieren auf kollaborativem Filtern und ML – sie analysieren das Verhalten von Millionen Nutzer:innen, um individuelle Empfehlungen zu generieren. Conversion-Rates steigen dabei nachweislich um 10–30 %.

Sprachassistenten & NLP

Siri, Alexa, Google Assistant und moderne NLP-Chatbots nutzen ML und Deep Learning, um gesprochene oder geschriebene Sprache zu verstehen. Natural Language Processing ist dabei das Bindeglied zwischen menschlicher Sprache und maschinellem Verständnis.

Autonomes Fahren

Selbstfahrende Autos verarbeiten Sensorströme (Kameras, LiDAR, Radar) in Echtzeit mithilfe von Deep-Learning-Modellen – und lernen kontinuierlich dazu, wie sie auf neue Verkehrssituationen reagieren sollen.

ML im Kundenservice: Wie OMQ es einsetzt

Ein besonders praxisnahes Beispiel für Maschinelles Lernen ist der Einsatz von KI-Chatbots und automatisierten Antwortsystemen im Kundenservice. Moderne Systeme wie OMQ verbinden klassisches ML mit modernen NLP-Ansätzen und LLMs.

Wie OMQ ML konkret nutzt

OMQ ist eine KI-basierte Kundenservice-Plattform, deren Kern eine zentrale, lernende Wissensdatenbank ist. Das System analysiert eingehende Kundenanfragen, versteht deren Bedeutung mithilfe von NLP und liefert automatisch passende Antworten – kanalübergreifend und in Echtzeit.

| OMQ-Produkt | ML-Einsatz |

|---|---|

| OMQ Chatbot | NLP-basiertes Intent-Matching, lernt aus jeder Konversation |

| OMQ Reply | Automatische E-Mail-Klassifikation und -beantwortung |

| OMQ Help | Semantische Suche im Hilfecenter, personalisierte Vorschläge |

| OMQ Assist | Echtzeit-Vorschläge für Agenten während der Bearbeitung |

| OMQ Contact | Vorausfüllen von Antworten direkt im Kontaktformular |

Das Besondere: Alle Produkte greifen auf dieselbe zentrale Wissensdatenbank zu. Jede neue Anfrage verbessert das System – das Modell lernt kontinuierlich dazu.

Typische Ergebnisse mit ML-gestütztem Kundenservice:

- Bis zu 80 % Automatisierungsrate bei Standardanfragen

- Rund-um-die-Uhr-Verfügbarkeit ohne zusätzliches Personal

- Signifikante Entlastung der Agenten, die sich auf komplexe Anfragen konzentrieren können

Herausforderungen und ethische Fragen

Trotz der beeindruckenden Fortschritte bringt Maschinelles Lernen auch erhebliche Herausforderungen mit sich:

Datenschutz und DSGVO

ML-Modelle benötigen große Mengen an Trainingsdaten. In der EU gilt dabei die DSGVO: Personenbezogene Daten dürfen nicht ohne Rechtsgrundlage verarbeitet werden. Mit dem EU AI Act, der seit 2024 schrittweise in Kraft tritt, gelten zusätzliche Transparenz- und Dokumentationspflichten für KI-Systeme.

Bias und Fairness

Wenn Trainingsdaten historische Ungleichheiten widerspiegeln, übernimmt das Modell diese Verzerrungen. Besonders kritisch: Kreditvergabe, Personalentscheidungen oder Strafverfolgung. Moderne ML-Praxis fordert daher explizite Fairness-Überprüfungen und diverse Datensätze.

Erklärbarkeit (Explainability)

Viele komplexe Modelle – insbesondere neuronale Netze und LLMs – sind „Black Boxes”: Sie liefern Ergebnisse, ohne dass klar ist, warum. Das macht es schwer, Entscheidungen zu begründen oder Fehler zu korrigieren. Explainable AI (XAI) ist ein aktives Forschungsfeld.

Halluzinationen bei LLMs

LLMs wie GPT-4 können plausibel klingende, aber faktisch falsche Aussagen generieren. Für unternehmenskritische Anwendungen müssen deshalb Kontrollmechanismen wie RAG, Human-in-the-Loop oder Fact-Checking eingesetzt werden. Mehr dazu: KI-Ethik.

Die Zukunft des Maschinellen Lernens

Maschinelles Lernen entwickelt sich 2026 in mehrere Richtungen gleichzeitig:

Multimodale Modelle wie GPT-4o oder Gemini 1.5 Pro verarbeiten Text, Bild, Audio und Video gemeinsam – und überwinden damit die Grenzen früherer Single-Task-Systeme.

AI Agents sind ML-Systeme, die eigenständig Aufgaben planen, Tools nutzen und mehrstufige Prozesse durchführen – ohne dass bei jedem Schritt ein Mensch eingreifen muss. Sie kombinieren LLMs mit Planung, Gedächtnis und Werkzeugnutzung.

AutoML demokratisiert den Zugang zu ML: Werkzeuge wie Google AutoML oder H2O.ai ermöglichen es auch Nicht-Expert:innen, leistungsstarke Modelle zu trainieren, ohne tiefes Fachwissen in Statistik oder Programmierung zu benötigen.

Edge ML verlagert Inferenz auf lokale Geräte (Smartphones, IoT-Sensoren), was Echtzeit-Verarbeitung ohne Cloud-Verbindung und mit besserem Datenschutz ermöglicht.

Regulierung durch den EU AI Act wird die Entwicklung und den Einsatz von ML-Systemen in Europa zunehmend strukturieren. Unternehmen müssen ihre Systeme nach Risikoklassen einordnen und dokumentieren.

Maschinelles Lernen im Kundenservice umsetzen

OMQ kombiniert bewährte ML-Methoden mit modernem NLP und LLM-Integration, um Unternehmen eine sofort einsetzbare KI-Lösung für den Kundenservice zu bieten – ohne eigenes Data-Science-Team.

| Produkt | Nutzen |

|---|---|

| OMQ Chatbot | Automatisiert bis zu 80% aller Chat-Anfragen |

| OMQ Reply | Beantwortet E-Mails automatisch mit ML-basierter Klassifikation |

| OMQ Help | Semantische Self-Service-Suche – Tickets werden vermieden |

| OMQ Assist | Unterstützt Agenten in Echtzeit mit intelligenten Vorschlägen |

| OMQ Contact | Löst Anfragen bereits im Kontaktformular |

Fazit

Maschinelles Lernen ist heute keine Zukunftstechnologie mehr – es ist die Grundlage der digitalisierten Welt, vom E-Mail-Filter bis zum selbstfahrenden Auto. Mit dem Aufstieg von LLMs und Generativer KI hat sich die Leistungsfähigkeit von ML in wenigen Jahren vervielfacht.

Für Unternehmen im Kundenservice bedeutet das: Intelligente Automatisierung ist keine Frage des Ob, sondern des Wie. Wer ML-Systeme gezielt einsetzt – mit klaren Daten, guter Wissensbasis und den richtigen Werkzeugen – kann Servicequalität und Effizienz gleichzeitig steigern.